Hinweis

Für den Zugriff auf diese Seite ist eine Autorisierung erforderlich. Sie können versuchen, sich anzumelden oder das Verzeichnis zu wechseln.

Für den Zugriff auf diese Seite ist eine Autorisierung erforderlich. Sie können versuchen, das Verzeichnis zu wechseln.

Von Bedeutung

Die Prioritätsverarbeitung befindet sich in der Vorschau und ist nur auf Einladung verfügbar. Registrieren Sie sich hier , um benachrichtigt zu werden, wenn sie umfassender verfügbar ist.

Diese Vorschauversion wird ohne Vereinbarung zum Servicelevel (SLA) bereitgestellt und ist nicht für Produktionsworkloads vorgesehen. Manche Features werden möglicherweise nicht unterstützt oder sind nur eingeschränkt verwendbar. Weitere Informationen finden Sie unter Supplementale Nutzungsbedingungen für Microsoft Azure Previews.

Die Prioritätsverarbeitung bietet eine geringe Latenzleistung mit der Flexibilität von Pay-as-you-go. Sie arbeitet auf einem Pay-as-you-go-Tokenmodell und bietet schnelle Reaktionszeiten ohne langfristige Vertragsverpflichtungen. In diesem Artikel aktivieren Sie die Prioritätsverarbeitung für eine Modellbereitstellung, überprüfen, welche Dienstebene Ihre Anforderungen verarbeitet hat, und überwachen die zugehörigen Kosten.

Voraussetzungen

- Ein Azure-Abonnement – Create one for free.

- Ein Microsoft Foundry-Projekt, bereitgestellt mit einem Modell des Bereitstellungstyps

GlobalStandardoderDataZoneStandard. - Zulassung zur Vorschau auf die Prioritätsverarbeitung. Registrieren Sie sich hier , um benachrichtigt zu werden, wenn die Prioritätsverarbeitung umfassender verfügbar ist.

- API-Version

2025-10-01-previewoder höher.

Überblick

Vorteile

- Vorhersehbare niedrige Latenz: Schnellere, konsistentere Tokengenerierung.

- Einfache, flexible Nutzung: Ähnlich wie bei der standardmäßigen Pay-as-you-go-Verarbeitung können Sie auf eine prioritäre Verarbeitung auf flexibler Pay-as-you-go-Basis zugreifen, anstatt im Voraus Bereitstellungen und Reservierungen vornehmen zu müssen.

Hauptanwendungsfälle

- Konsistente, niedrige Latenz für reaktionsfähige Benutzeroberflächen.

- Einfachheit der nutzungsabhängigen Abrechnung ohne langfristige Verpflichtungen.

- Datenverkehr zu Geschäftszeiten oder mit Spitzen, der von einer skalierbaren, kosteneffizienten Leistung profitiert. Optional können Sie die Prioritätsverarbeitung mit bereitgestellten Durchsatzeinheiten (Provisioned Throughput Units, PTU) kombinieren, um eine gleichmäßige Kapazität und Kostenoptimierung zu erzielen.

Grenzen

Rampenlimit: Eine schnelle Erhöhung Ihrer Prioritätsverarbeitungstoken pro Minute kann dazu führen, dass Rampenbegrenzungen erreicht werden. Wenn Sie das Rampenratenlimit überschreiten, sendet der Dienst möglicherweise stattdessen zusätzlichen Datenverkehr an die Standardverarbeitung.

Quote: Die Prioritätsverarbeitung verwendet dasselbe Kontingent wie die Standardverarbeitung. Das bedeutet, dass Ihre Bereitstellung mit aktivierter Prioritätsverarbeitung Kontingente aus Ihrer bestehenden Standardzuweisung verbraucht.

Unterstützung für die Prioritätsverarbeitung

Globale Standardmodellverfügbarkeit

| Region | gpt-4.1, 2025-04-14 |

|---|---|

| Eastus 2 | ✅ |

| schwedencentral | ✅ |

| westus3 | ✅ |

Hinweis

Die Verfügbarkeit von Modell und Region kann während des Vorschauzeitraums erweitert werden. Auf dieser Seite finden Sie Updates.

Bekannte Probleme

Die Prioritätsverarbeitung hat derzeit diese Einschränkungen, und Korrekturen werden ausgeführt:

Langer Kontextgrenzwert für gpt-4.1: Der Dienst unterstützt keine Anforderungen, die 128.000 Token überschreiten, und gibt einen HTTP 400-Fehler zurück.

Keine Unterstützung für PTU-Überlauf: Der Dienst unterstützt noch keinen PTU-Überlauf auf eine Bereitstellung mit aktivierter Prioritätsverarbeitung. Wenn Sie ein Überlaufverhalten benötigen, implementieren Sie Ihre eigene Logik, z. B. mithilfe von Azure API Management.

Falscher Wert für service_tier bei Verwendung von Streaming in der Responses-API: Beim Streaming von Antworten über die Responses-API kann das Feld

service_tierfälschlicherweise „Priorität“ zurückgeben, auch wenn die Anfrage aufgrund von Kapazitätsbeschränkungen oder Ramp-Limits vom Standard-Tier bedient wurde. In diesem Fall lautet der erwartete Wertservice_tier"default".

Aktivieren der Prioritätsverarbeitung auf Bereitstellungsebene

Sie können die Prioritätsverarbeitung auf Bereitstellungsebene und (optional) auf Anforderungsebene aktivieren.

Im Portal Microsoft Foundry können Sie die Prioritätsverarbeitung während der Bereitstellungseinrichtung aktivieren. Aktivieren Sie die Option "Prioritätsverarbeitung (Vorschau)" auf der Seite mit den Bereitstellungsdetails, wenn Sie die Bereitstellung erstellen oder die Einstellung eines bereitgestellten Modells aktualisieren, indem Sie die Bereitstellungsdetails bearbeiten.

Hinweis

Wenn Sie code verwenden möchten, um die Prioritätsverarbeitung auf Bereitstellungsebene zu aktivieren, können Sie dies über die REST-API für die Bereitstellung tun, indem Sie das service_tier Attribut wie folgt festlegen: "properties" : {"service_tier" : "priority"} Zulässige Werte für das service_tier Attribut sind default und priority.

default impliziert die Standardverarbeitung, während priority die Prioritätsverarbeitung ermöglicht.

Sobald eine Modellbereitstellung für die Verwendung der Prioritätsverarbeitung konfiguriert ist, können Sie mit dem Senden von Anforderungen an das Modell beginnen.

Anzeigen von Nutzungsmetriken

Sie können das Auslastungsmaß für Ihre Ressource im Abschnitt Azure Überwachen im Azure portal anzeigen.

Um das Volumen der Anforderungen darzustellen, die durch Standard- versus Prioritätsverarbeitung abgewickelt werden, getrennt nach der Dienststufe (Standard oder Priorität), die in der ursprünglichen Anforderung angegeben war:

- Melden Sie sich bei https://portal.azure.com an.

- Wechseln Sie zu Ihrer Azure OpenAI-Ressource, und wählen Sie im linken Navigationsbereich die Option Metrics aus.

- Fügen Sie auf der Metrikseite die Azure OpenAI-AnforderungenMetrik hinzu. Sie können auch andere Metriken wie Azure OpenAI-Latenz, Azure OpenAI-Verwendung und andere auswählen.

- Wählen Sie "Filter hinzufügen" aus, um die Standardbereitstellung auszuwählen, für die Prioritätsverarbeitungsanforderungen verarbeitet wurden.

- Wählen Sie "Aufteilen anwenden" aus, um die Werte nach ServiceTierRequest und ServiceTierResponse aufzuteilen.

Weitere Informationen zur Überwachung Ihrer Bereitstellungen finden Sie unter Monitor Azure OpenAI.

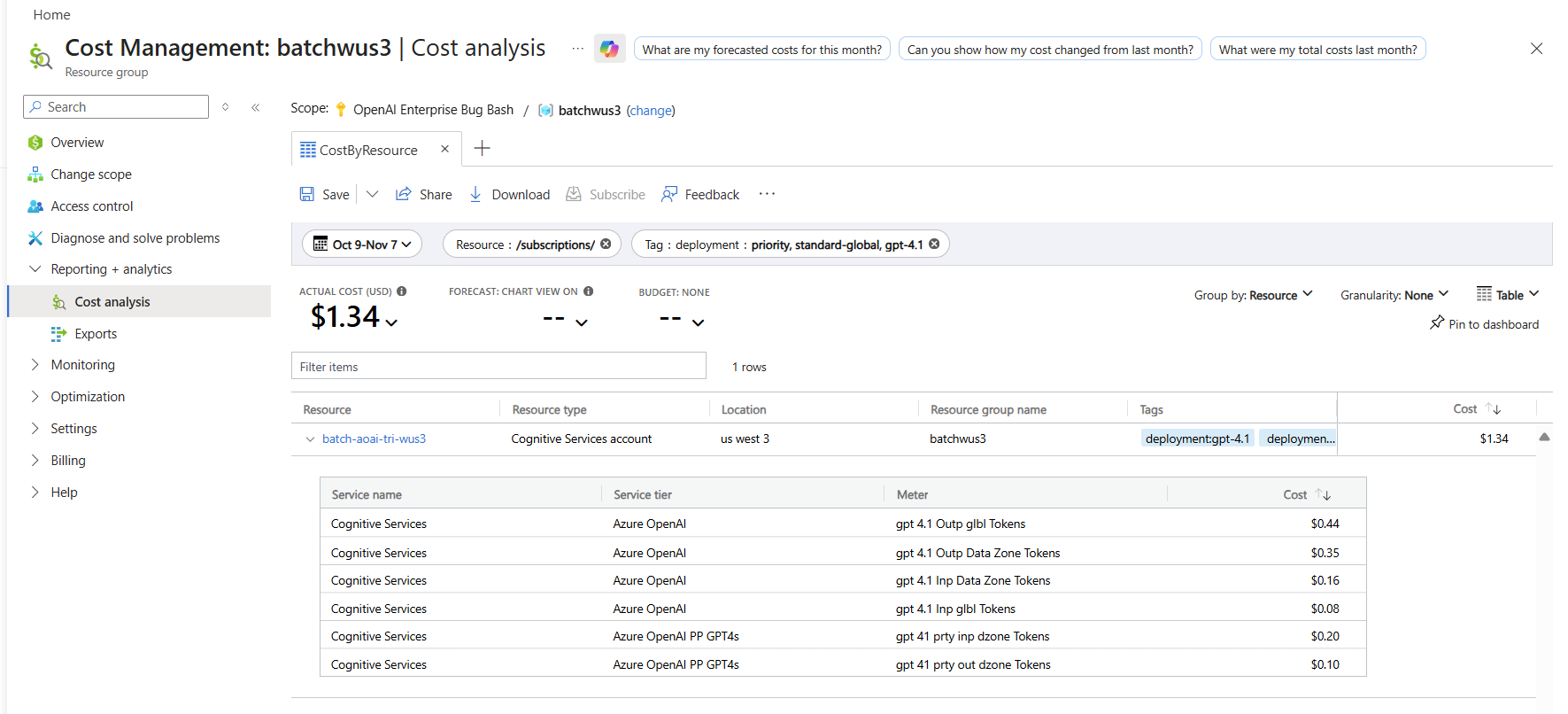

Kosten überwachen

Sie können eine Aufschlüsselung der Kosten für Prioritäts- und Standardanforderungen auf der Kostenanalyseseite des Azure portal anzeigen, indem Sie wie folgt nach Bereitstellungsnamen und Abrechnungstags filtern:

- Wechseln Sie zur Kostenanalyseseite im Azure portal.

- (Optional) Filtern nach Ressource.

- Filtern nach Bereitstellungsname: Fügen Sie einen Filter für Abrechnungs-Tag> hinzu, wählen Sie Bereitstellung als Wert aus und wählen Sie dann Ihren Bereitstellungsnamen.

Informationen zur Preisgestaltung für die Prioritätsverarbeitung finden Sie in der Azure OpenAI Service Preisübersicht.

Aktivieren der Prioritätsverarbeitung auf Anforderungsebene

Die Aktivierung der Prioritätsverarbeitung auf Anforderungsebene ist optional. Sowohl die API für Chatabschlusse als auch die Antwort-API verfügen über ein optionales Attribut service_tier , das den Verarbeitungstyp angibt, der beim Verarbeiten einer Anforderung verwendet werden soll. Das folgende Beispiel zeigt, wie service_tier in einer Antwortanfrage in priority festgelegt werden kann.

curl -X POST https://YOUR-RESOURCE-NAME.openai.azure.com/openai/v1/responses \

-H "Content-Type: application/json" \

-H "Authorization: Bearer $AZURE_OPENAI_AUTH_TOKEN" \

-d '{

"model": "gpt-4.1",

"input": "This is a test",

"service_tier": "priority"

}'

Verwenden Sie das service_tier Attribut, um die Einstellung auf Bereitstellungsebene außer Kraft zu setzen.

service_tier kann die Werte auto, default und priority haben.

Wenn Sie das Attribut nicht festlegen, wird es standardmäßig auf

auto.service_tier = autobedeutet, dass die Anforderung die in der Bereitstellung konfigurierte Dienstebene verwendet.service_tier = defaultbedeutet, dass die Anforderung die Standardpreise und -leistung für das ausgewählte Modell verwendet.service_tier = prioritybedeutet, dass die Anforderung die Dienstebene für die Prioritätsverarbeitung verwendet.

In der folgenden Tabelle wird zusammengefasst, für welche Dienstebene Ihre Anforderungen basierend auf den Einstellungen service_tierauf Bereitstellungsebene und Anforderungsebene verarbeitet werden.

| Einstellung auf Bereitstellungsebene | Einstellungen auf Anfrageebene | Anforderung, die von Dienstebene verarbeitet wird |

|---|---|---|

| Standardwert | Auto, Standard | Norm |

| Standardwert | priority | Vorrangverarbeitung |

| priority | Auto, Priorität | Vorrangverarbeitung |

| priority | Standardwert | Norm |

Ziel-Latenz

| Thema | gpt-4.1, 2025-04-14 |

|---|---|

| Latenz-Zielwert | 99 % > 80 Token pro Sekunde* |

* Berechnet als p50-Anforderungslatenz pro Grundlage von 5 Minuten.

Grenzwerte für Rampenraten

Um eine konsistente hohe Leistung für alle Kunden sicherzustellen und gleichzeitig flexible On-Demand-Preise bereitzustellen, erzwingt die Prioritätsverarbeitung Rampenratenlimits. Derzeit wird der Ratengrenzwert für Hochfahren als Erhöhung des Datenverkehrs um mehr als 50% Token pro Minute in weniger als 15 Minuten definiert.

Downgrade-Bedingungen

Wenn die Leistung der Prioritätsverarbeitung beeinträchtigt wird und der Datenverkehr eines Kunden zu schnell hochgefahren wird, kann der Dienst einige Prioritätsanforderungen auf die Standardverarbeitung herabstufen. Der Dienst berechnet die von der Standard-Dienstebene bearbeiteten Anfragen zu Standardtarifen. Diese Anforderungen sind nicht für das Ziel der Prioritätsverarbeitungslatenz berechtigt. Anfragen, die von der Standarddienststufe verarbeitet werden, enthalten service_tier = default in der Antwort.

Tipp

Wenn Sie regelmäßig auf Ratengrenzwerte für Hochfahren stoßen, sollten Sie den Kauf von PTU anstelle oder zusätzlich zur Prioritätsverarbeitung in Betracht ziehen.

Problembehandlung

| Thema | Ursache | Beschluss |

|---|---|---|

| HTTP 400-Fehler bei langen Eingabeaufforderungen | gpt-4.1 unterstützt keine Anforderungen, die 128.000 Token bei der Prioritätsverarbeitung überschreiten. | Halten Sie die Gesamtanforderungstoken unter 128.000. Teilen Sie lange Eingabeaufforderungen in kleinere Anforderungen auf. |

| Anforderungen, die auf die Standardebene herabgestuft wurden | Der Datenverkehr stieg in weniger als 15 Minuten um mehr als 50 % Token pro Minute und erreichte die Obergrenze der Anstiegsrate. | Erhöhen Sie den Verkehr schrittweise. Erwägen Sie den Erwerb von PTU für die stetige Kapazität. |

| PTU-Überlauf funktioniert nicht | Die Prioritätsverarbeitung unterstützt noch keinen PTU-Überlauf zu einer für die Prioritätsverarbeitung geeigneten Bereitstellung. | Implementieren Sie benutzerdefinierte Überlauflogik, z. B. mithilfe von Azure API Management. |

service_tier gibt während des Streamings einen falschen Wert zurück. |

Beim Streamen über die Antwort-API service_tier kann "priority" gemeldet werden, wenn die Anforderung von der Standardebene bereitgestellt wurde. |

Überprüfen Sie die Abrechnungseinträge, um zu bestätigen, welche Ebene die Anforderung tatsächlich verarbeitet hat. |

API-Unterstützung

| API-Version | |

|---|---|

| Neueste unterstützte Vorschau-API-Version: | 2025-10-01-preview |